Documentation Index

Fetch the complete documentation index at: https://docs.casebender.com/llms.txt

Use this file to discover all available pages before exploring further.

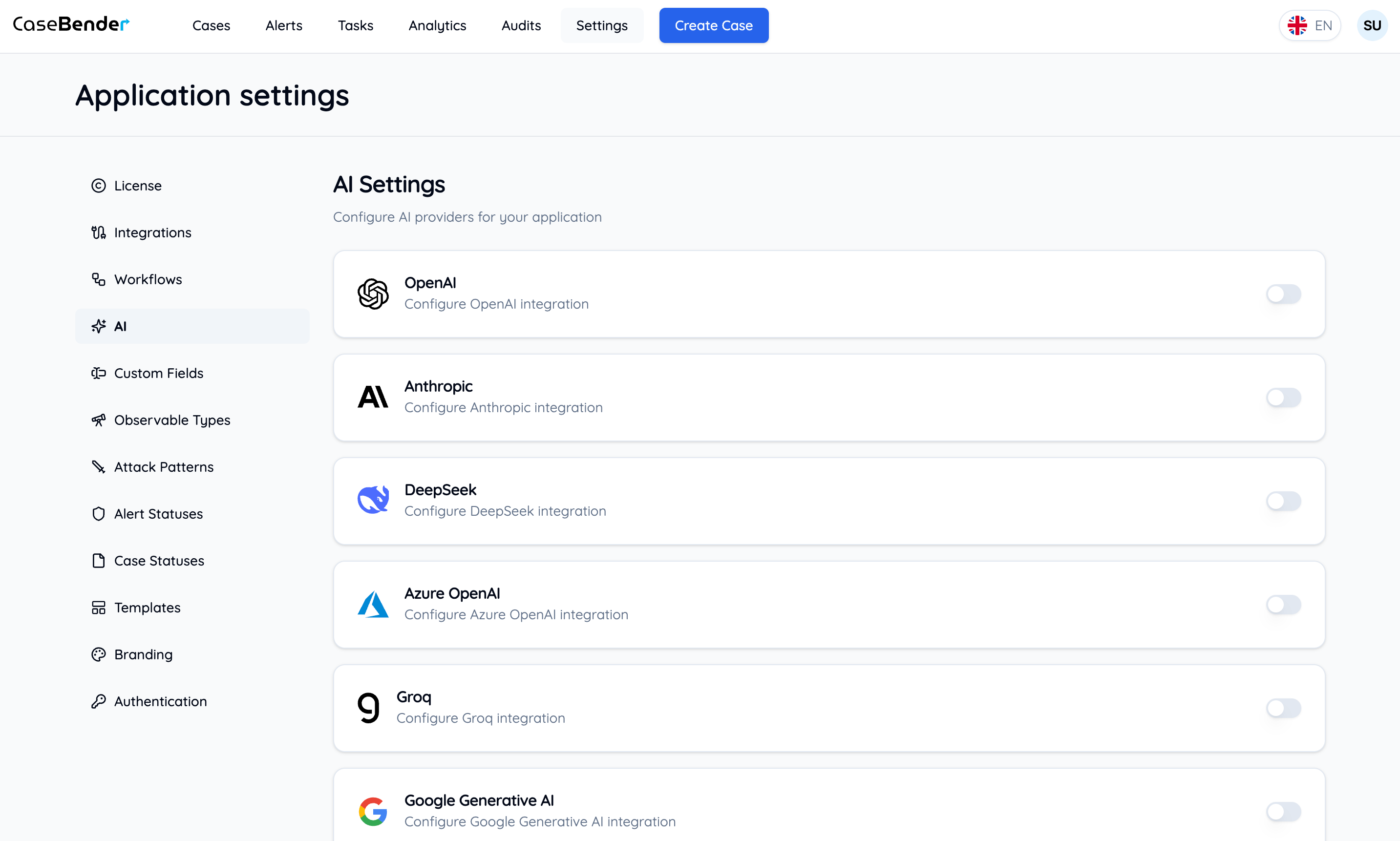

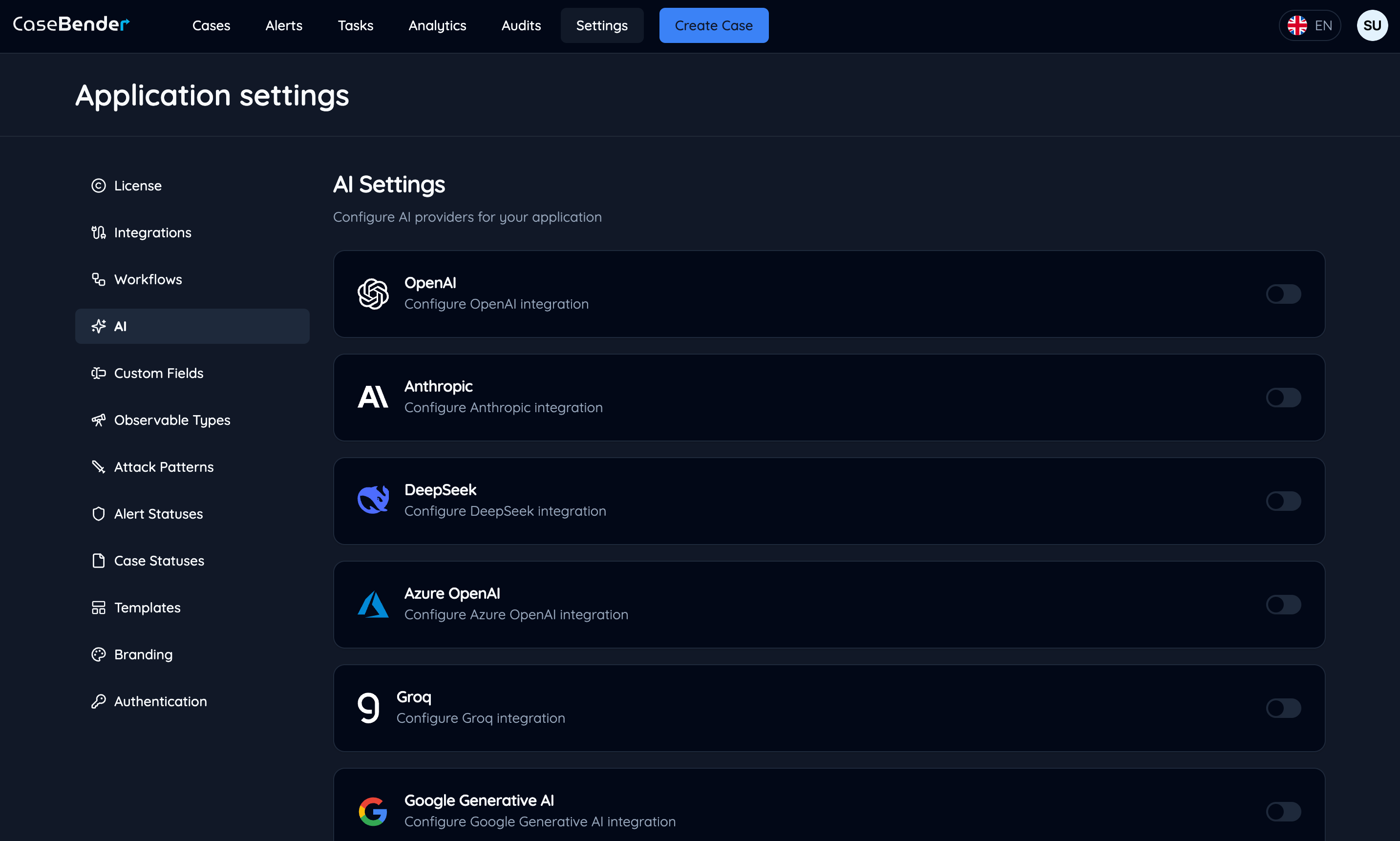

Panoramica

La sezione Impostazioni IA ti permette di configurare vari provider di intelligenza artificiale per migliorare la tua esperienza CaseBender con funzionalità intelligenti. Questo include la configurazione di provider come OpenAI, Anthropic e altri per alimentare funzionalità come l’analisi dei casi, la generazione di contenuti e l’elaborazione automatizzata.

Configurazione dei Provider IA

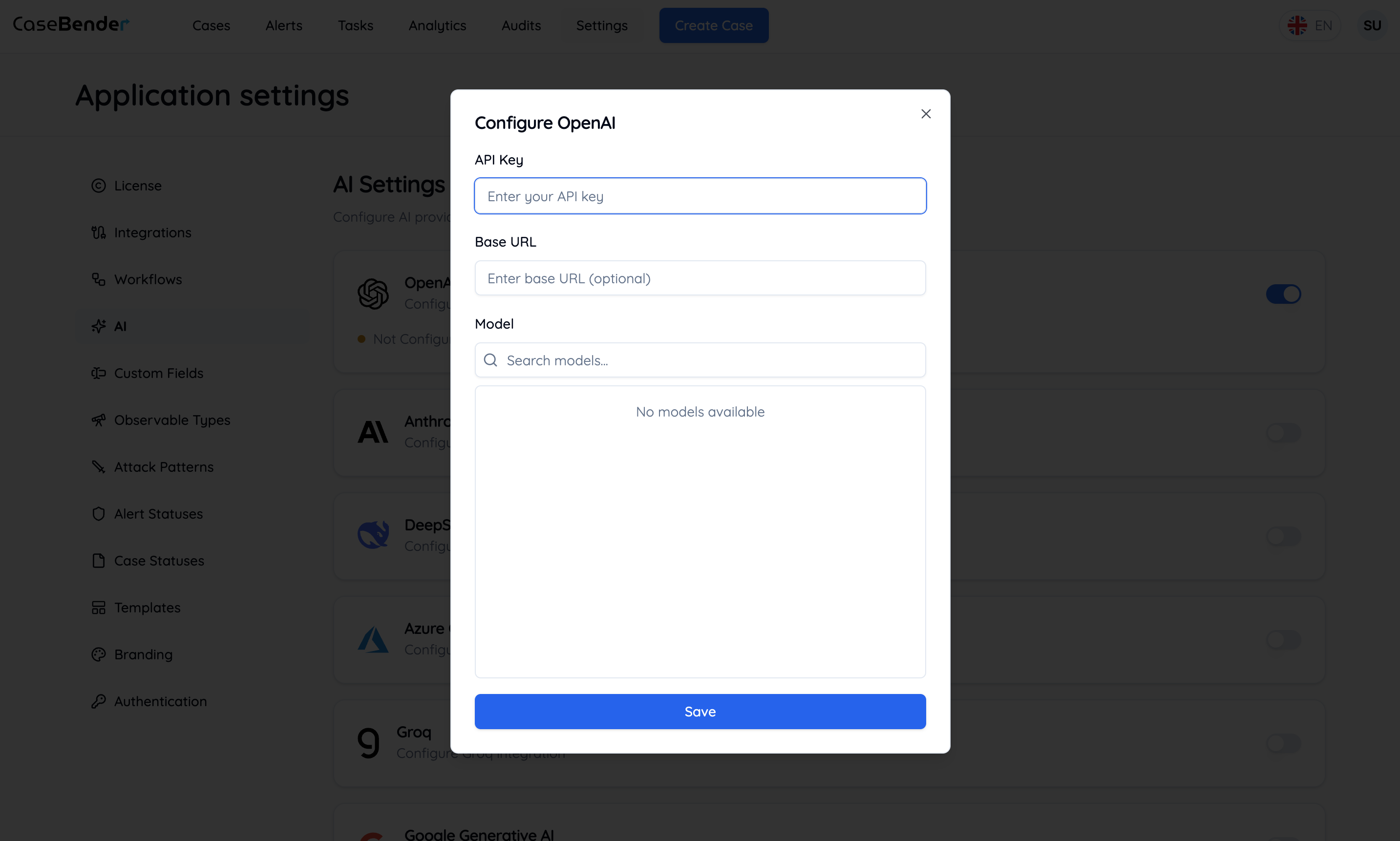

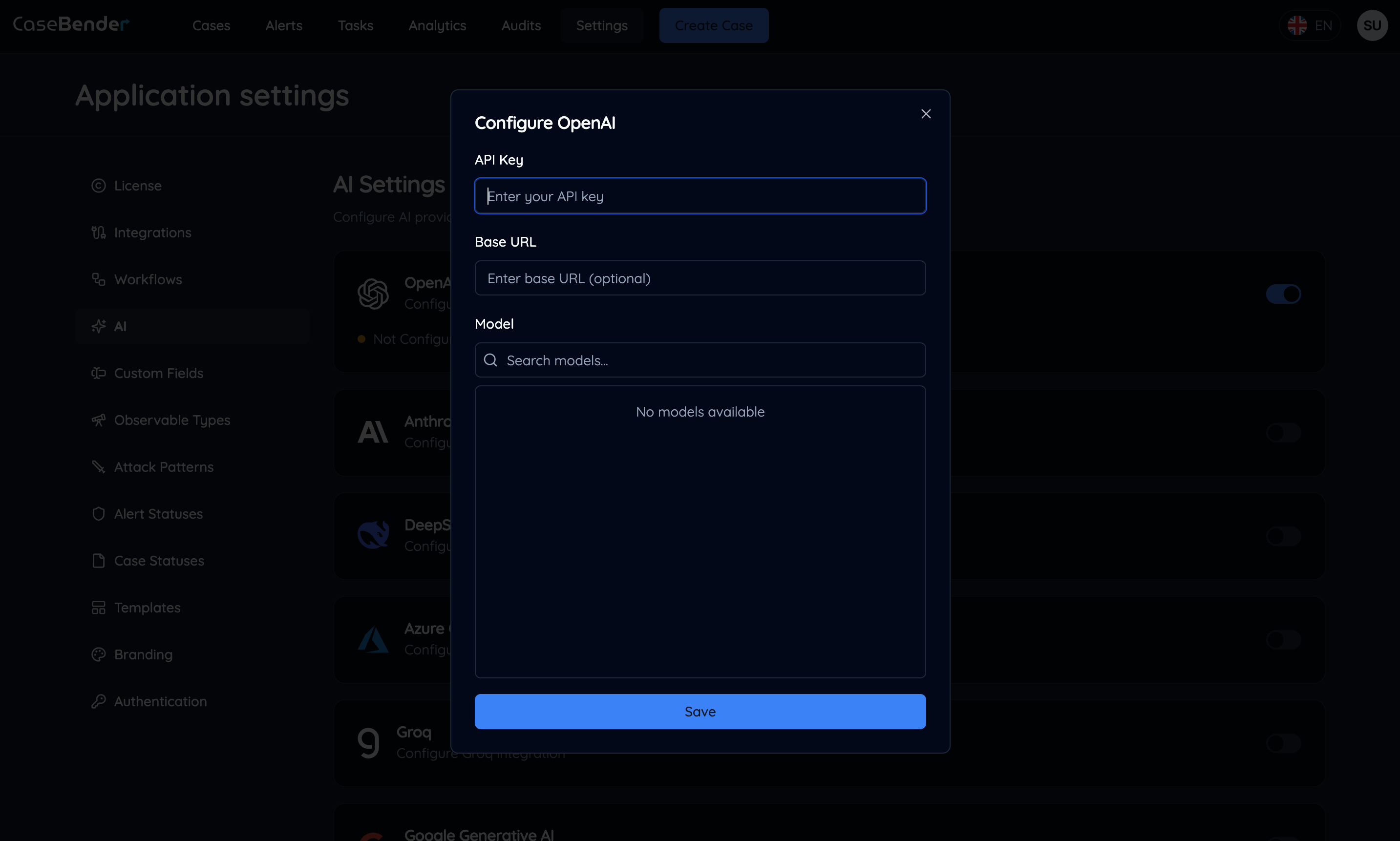

Passo 1: Abilita Provider

Per iniziare a utilizzare un provider IA, individua la scheda del provider nella dashboard e attiva l’interruttore di abilitazione:

- Inserire la tua chiave API

- Configurare le impostazioni di base

- Impostare limiti di utilizzo

- Definire i permessi di accesso

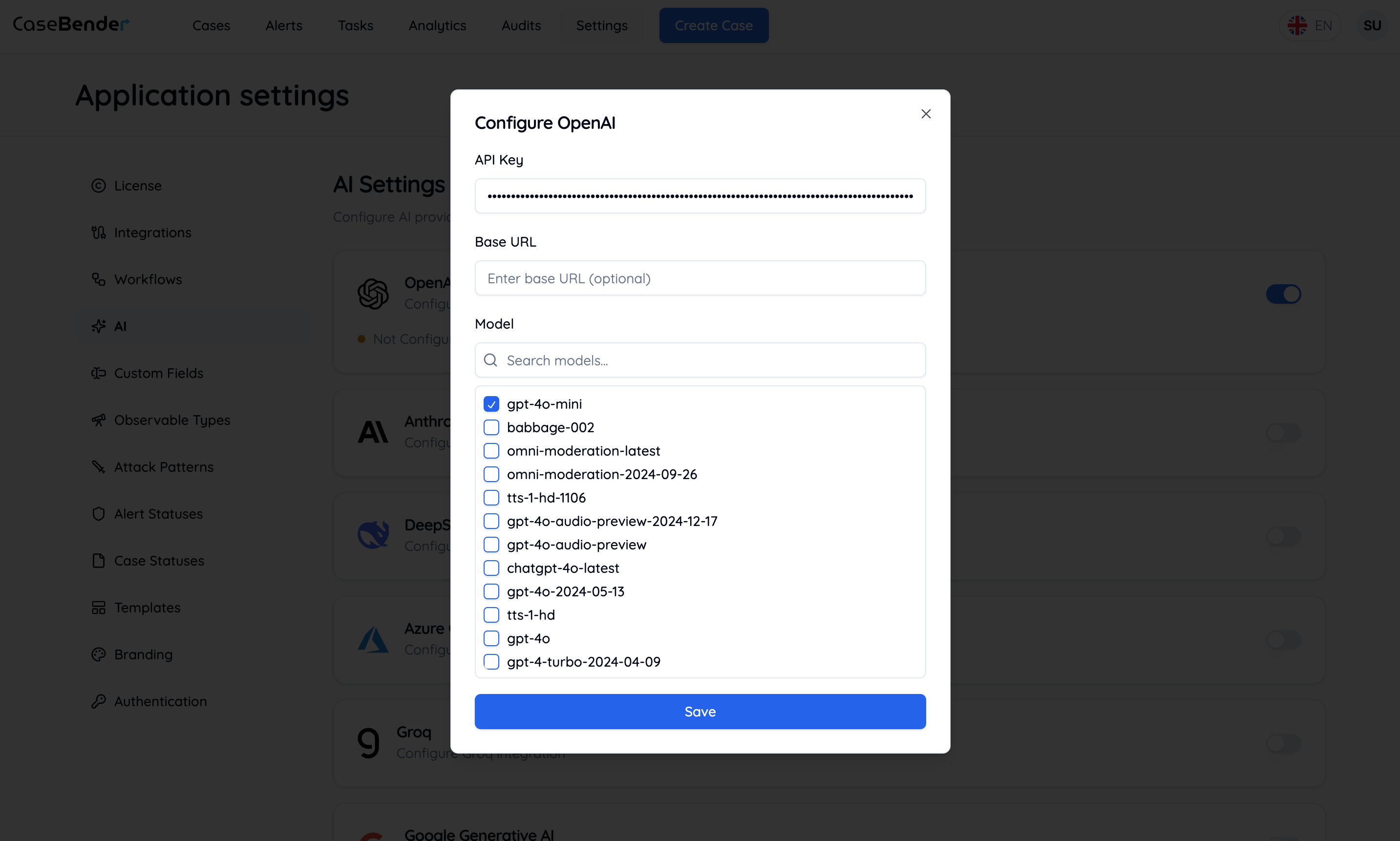

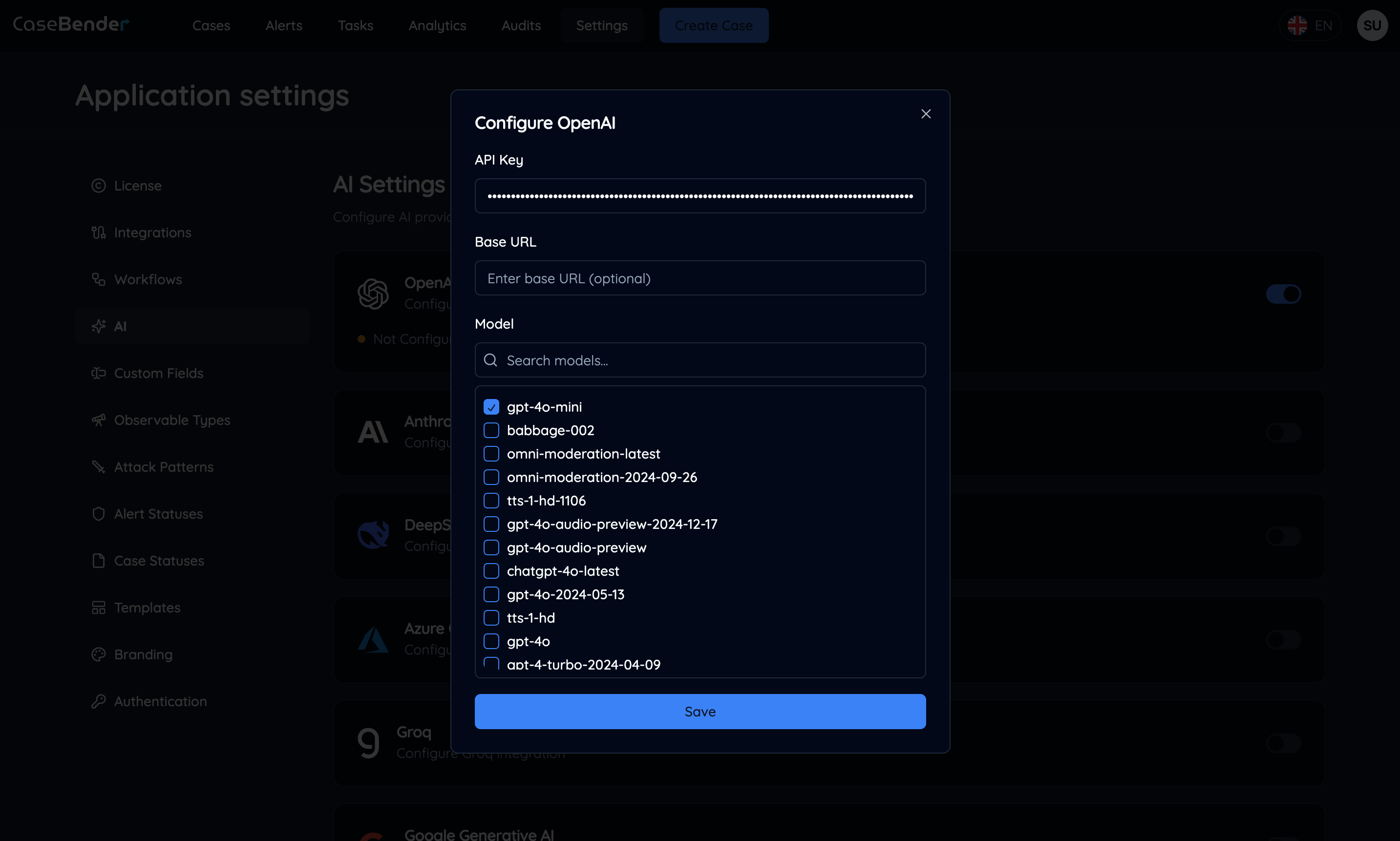

Passo 2: Selezione del Modello

Dopo aver inserito una chiave API valida, vedrai i modelli disponibili per il provider:

- Seleziona i modelli preferiti

- Imposta parametri specifici del modello

- Configura quote di utilizzo

- Definisci permessi di accesso al modello

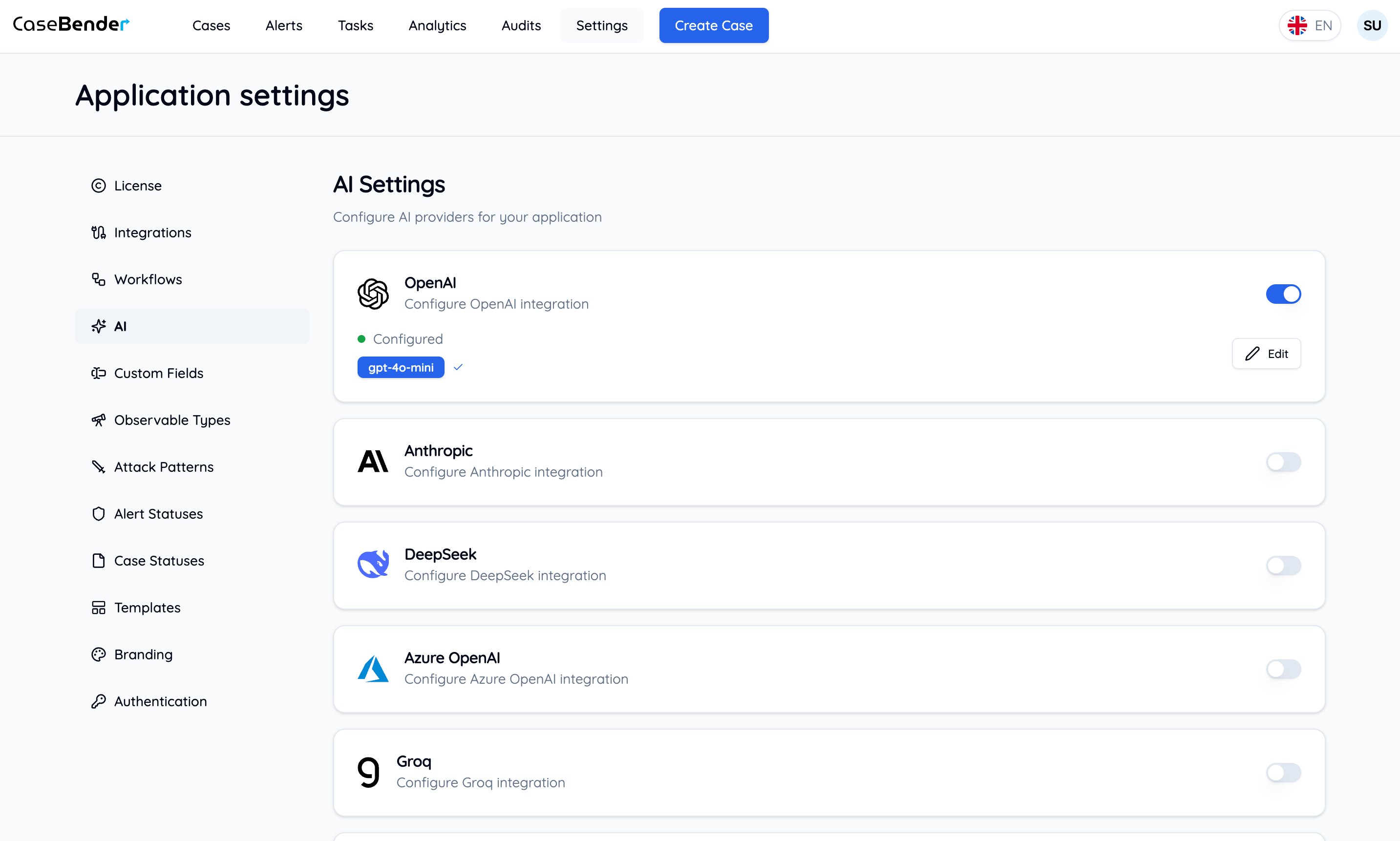

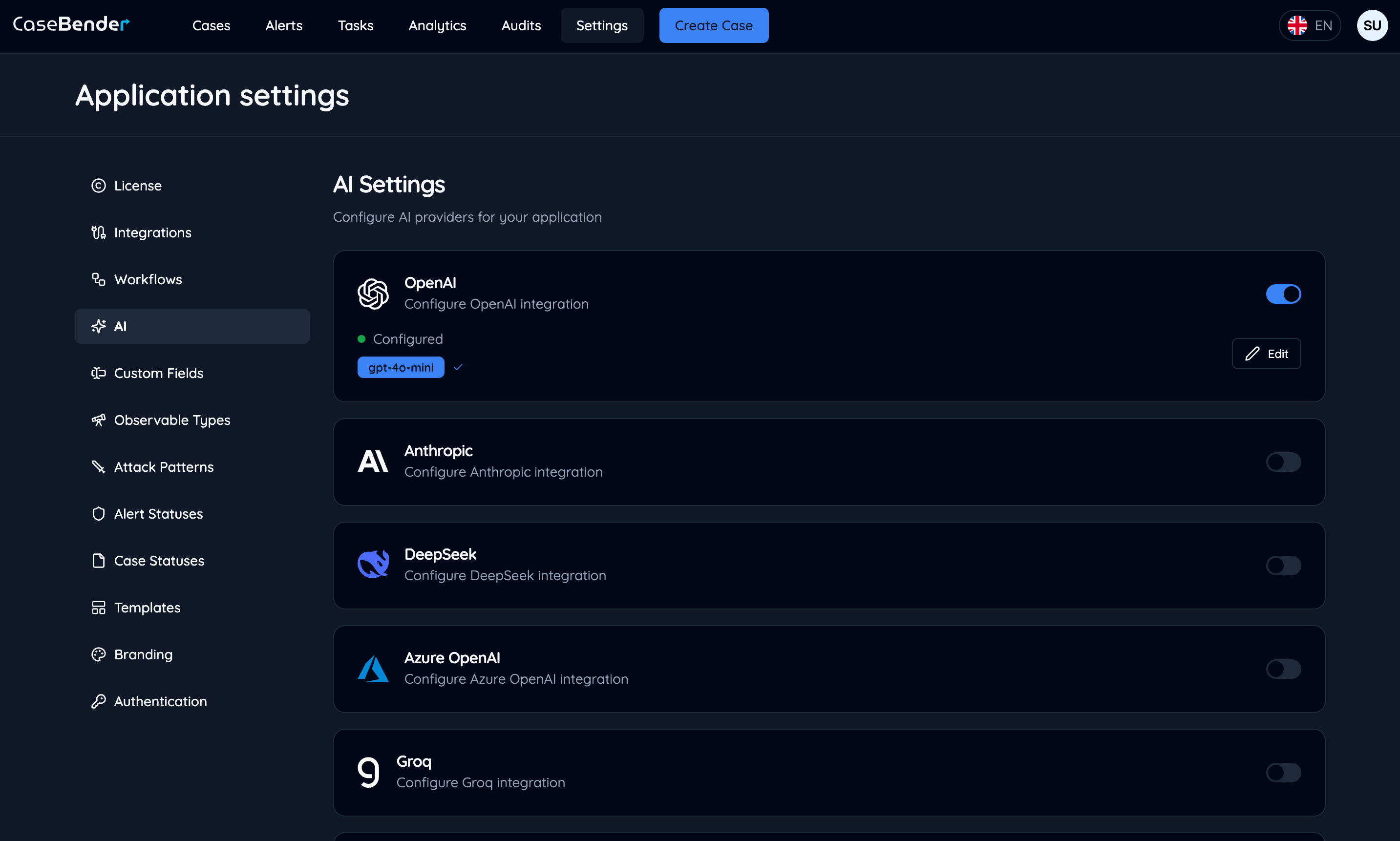

Passo 3: Configurazione Provider Completata

Una volta configurato, la scheda del provider mostrerà il suo stato attivo e i dettagli di configurazione:

- Stato attivo

- Modelli selezionati

- Statistiche di utilizzo

- Accesso rapido alle impostazioni

Provider Disponibili

OpenAI

- Modelli GPT-4 e GPT-3.5

- Generazione e analisi del testo

- Assistenza al codice

- Estrazione dati

Anthropic

- Modelli Claude e Claude 2

- Ragionamento avanzato

- Analisi documenti

- Gestione attività complesse

Deepseek

- Modelli Deepseek-coder

- Generazione e analisi del codice

- Documentazione tecnica

- Assistenza alla programmazione

Azure OpenAI

- Servizi OpenAI gestiti

- Funzionalità di sicurezza enterprise

- Disponibilità regionale

- Risorse dedicate

Groq

- Inferenza LPU

- Elaborazione ultra-veloce

- Modelli ad alte prestazioni

- Risposte a bassa latenza

Google AI

- Modelli PaLM e Gemini

- Capacità multi-modali

- Comprensione avanzata del linguaggio

- Affidabilità di livello enterprise

xAI

- Modelli Grok

- Integrazione conoscenze in tempo reale

- IA conversazionale

- Risposte contestuali

Ollama

- Implementazione modelli locali

- Supporto modelli personalizzati

- Elaborazione offline

- Inferenza efficiente in termini di risorse

Migliori Pratiche

Sicurezza

- Archivia in modo sicuro le chiavi API

- Ruota regolarmente le credenziali

- Monitora l’utilizzo delle API

- Imposta controlli di accesso appropriati

Gestione dei Costi

- Configura limiti di utilizzo

- Monitora il consumo di token

- Imposta quote specifiche per modello

- Traccia i modelli di utilizzo

Prestazioni

- Scegli modelli appropriati

- Ottimizza l’ingegneria dei prompt

- Monitora i tempi di risposta

- Configura le impostazioni di timeout

Manutenzione

- Verifica regolarmente lo stato del provider

- Aggiorna le chiavi API prima della scadenza

- Monitora la disponibilità del modello

- Mantieni aggiornate le configurazioni

Funzionalità Abilitate dall’IA

Gestione Casi

- Analisi automatizzata dei casi

- Sintesi dei contenuti

- Valutazione delle priorità

- Identificazione casi correlati

Elaborazione Documenti

- Estrazione testo

- Classificazione documenti

- Analisi contenuti

- Evidenziazione informazioni chiave

Automazione Flussi di Lavoro

- Instradamento intelligente

- Generazione contenuti

- Supporto decisionale

- Riconoscimento pattern